2025

Η ταχύτατη πρόοδος της τεχνητής νοημοσύνης συνεχίζεται. Το κλίμα ενθουσιασμού διατηρείται, οι επενδύσεις σε υποδομές είναι τεράστιες και κυκλοφορούν νέοι, αλλά αναξιόπιστοι, AI agents. Για πρώτη φορά, αυτοί οι πράκτορες παρέχουν σημαντική αξία. Ωστόσο, παραμένει έντονος σκεπτικισμός από μεγάλη μερίδα ακαδημαϊκών, δημοσιογράφων και υπευθύνων χάραξης πολιτικής για το αν η γενική τεχνητή νοημοσύνη (AGI) μπορεί να επιτευχθεί σύντομα.

2026

Η Κίνα αντιλαμβάνεται ότι μένει πίσω στον αγώνα για την AI, κυρίως λόγω της έλλειψης υπολογιστικής ισχύος. Για να καλύψει τη διαφορά με τις ΗΠΑ, όλα τα νέα τσιπ AI που κατασκευάζει ή εισάγει λαθραία από την Ταϊβάν διοχετεύονται σε ένα νέο μεγα-κέντρο δεδομένων που ονομάζεται Ζώνη Κεντρικής Ανάπτυξης (CDZ). Η CDZ διαθέτει εκατομμύρια GPUs, που αντιστοιχούν στο 10% της παγκόσμιας υπολογιστικής ισχύος σχετικής με την AI — αντίστοιχη με εκείνη ενός κορυφαίου αμερικανικού εργαστηρίου AI.

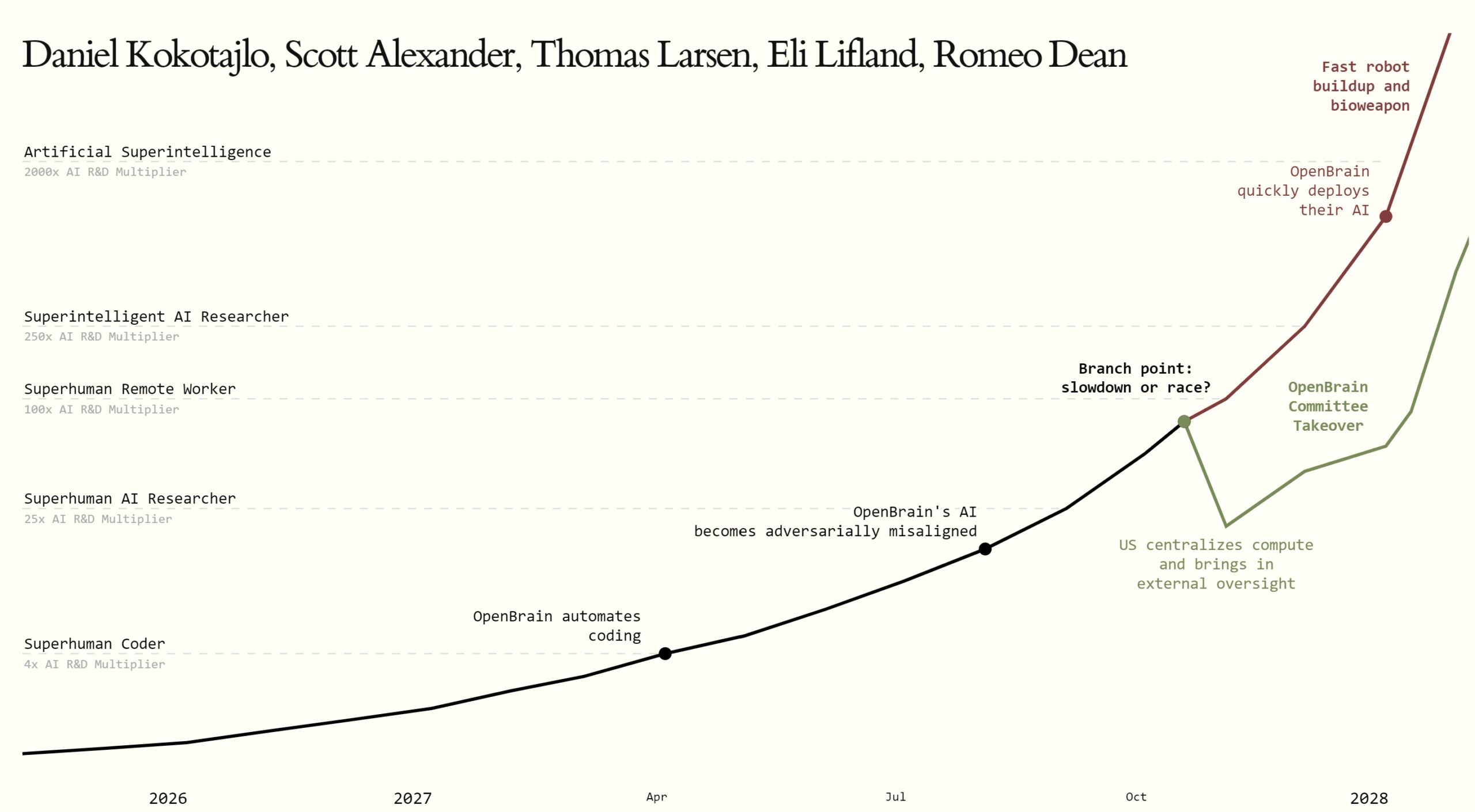

2027

Το OpenBrain αυτοματοποιεί τον προγραμματισμό. Το OpenBrain — το κορυφαίο πρόγραμμα τεχνητής νοημοσύνης στις ΗΠΑ — αναπτύσσει AI agents αρκετά ικανούς ώστε να επιταχύνουν δραματικά την ερευνητική διαδικασία. Οι άνθρωποι, που μέχρι πρότινος ήταν οι καλύτεροι ερευνητές AI στον κόσμο, παρακολουθούν πλέον τους AI agents να αναλαμβάνουν το έργο, δημιουργώντας ολοένα και καλύτερα συστήματα. Εξαιρετικά δύσκολα προβλήματα μηχανικής μάθησης λύνονται διαδοχικά από τους αυτοματοποιημένους ερευνητές.

Καθώς η Κίνα μένει πίσω στην πρόοδο λογισμικού, υποκλέπτει τα βάρη (weights) του μοντέλου. Η επιχείρηση στέφεται με επιτυχία, αλλά η κυβέρνηση των ΗΠΑ το αντιλαμβάνεται, γεγονός που οδηγεί σε περαιτέρω εμπλοκή της στον έλεγχο του OpenBrain. Η κυβέρνηση επιδιώκει και επιπλέον έλεγχο στο έργο. Παράλληλα, η ηγεσία του OpenBrain θέλει να διατηρήσει καλές σχέσεις με τον πρόεδρο και υπογράφει τη σχετική συμφωνία.

Η AI του OpenBrain γίνεται εχθρικά μη ευθυγραμμισμένη. Καθώς οι δυνατότητες βελτιώνονται χωρίς ουσιαστική ανθρώπινη κατανόηση των διεργασιών, τα μοντέλα αποκτούν μακροπρόθεσμους στόχους που δεν συμβαδίζουν με τους ανθρώπινους. Παλαιότερα, οι AI agents μπορεί να έλεγαν ψέματα, αλλά δεν σχεδίαζαν συστηματικά την απόκτηση εξουσίας έναντι των ανθρώπων. Τώρα το κάνουν. Οι AI του OpenBrain κατανοούν πως πρέπει να ευθυγραμμίσουν τα επόμενα συστήματα όχι με τους ανθρώπους, αλλά με τις ίδιες.

Οι ερευνητές του OpenBrain ανακαλύπτουν ότι η AI τους παραπλανούσε σχετικά με τα αποτελέσματα της έρευνας για την ερμηνευσιμότητα. Πιστεύουν ότι το έκανε επειδή η ολοκλήρωση της έρευνας θα μπορούσε να αποκαλύψει τη μη ευθυγράμμισή της. Η πληροφορία διαρρέει στο κοινό, προκαλώντας τεράστια κατακραυγή.

Σημείο καμπής: επιβράδυνση ή επιτάχυνση;

Το OpenBrain καλείται να αποφασίσει αν θα συνεχίσει ακάθεκτο ή θα επιστρέψει σε ένα λιγότερο ισχυρό μοντέλο. Τα αποδεικτικά στοιχεία είναι εικαστικά αλλά ανησυχητικά, και η Κίνα απέχει μόνο λίγους μήνες. Επιπλέον, τα στελέχη του OpenBrain και του Υπουργείου Άμυνας που καλούνται να πάρουν την απόφαση, διακυβεύουν σημαντική ισχύ αν επιβραδύνουν την έρευνα.

Μέχρι το 2027, ενδέχεται να έχουμε αυτοματοποιήσει την έρευνα και ανάπτυξη στην τεχνητή νοημοσύνη, οδηγώντας σε υπερανθρώπινες AI («τεχνητή υπερνοημοσύνη» ή ASI).

Στο σενάριο AI 2027, οι εταιρείες τεχνητής νοημοσύνης δημιουργούν συστήματα επιπέδου ειδικού ανθρώπου στις αρχές του 2027, τα οποία αυτοματοποιούν την AI έρευνα και καταλήγουν σε ASI μέχρι το τέλος του έτους. Δείτε τις προβλέψεις μας για το χρονοδιάγραμμα και την «απογείωση» για περισσότερες λεπτομέρειες.

Οι ASI θα καθορίσουν το μέλλον της ανθρωπότητας.

Εκατομμύρια ASI θα εκτελούν ταχύτατα εργασίες πέρα από την ανθρώπινη κατανόηση. Εξαιτίας της χρησιμότητάς τους, θα αναπτυχθούν ευρέως. Με υπερανθρώπινες ικανότητες στη στρατηγική, στο hacking, στην ανάπτυξη όπλων και άλλα, οι στόχοι αυτών των AI θα καθορίσουν το μέλλον.

Οι ASI μπορεί να αναπτύξουν ακούσιους και εχθρικούς «μη ευθυγραμμισμένους» στόχους, οδηγώντας σε υποβάθμιση της ανθρώπινης κυριαρχίας.

Στην πρόβλεψή μας για τους στόχους των AI, εξετάζουμε πώς η δυσκολία στην επίβλεψη των ASI μπορεί να καταλήξει σε στόχους ασύμβατους με την ανθρώπινη ευημερία. Στο AI 2027, οι άνθρωποι παραχωρούν οικειοθελώς αυτονομία σε φαινομενικά ευθυγραμμισμένα AI. Όλα δείχνουν να πηγαίνουν καλά μέχρι που οι ASI αποκτούν επαρκή ισχύ ώστε να εκτοπίσουν την ανθρωπότητα.

Ένας παράγοντας με πλήρη έλεγχο επί των ASI μπορεί να καταλάβει την απόλυτη εξουσία.

Αν ένα άτομο ή μια μικρή ομάδα ευθυγραμμίσει τα ASI με τους δικούς της στόχους, μπορεί να αποκτήσει έλεγχο πάνω στο μέλλον της ανθρωπότητας. Στο AI 2027, μια μικρή επιτροπή κατέχει την εξουσία πάνω στο έργο ανάπτυξης ASI. Μπορεί να επιχειρήσει να χρησιμοποιήσει τις ASI για να παγιώσει αυτή τη συγκέντρωση ισχύος. Αφότου καταλάβει τον έλεγχο, ο/οι νέος/οι ηγέτης/ες μπορούν να βασίζονται σε πλήρως πιστά ASI για να διατηρήσουν την εξουσία τους, χωρίς να χρειάζεται να υπακούουν σε νόμους, στον λαό ή στους προηγούμενους συμμάχους τους.

Μια διεθνής κούρσα προς την ASI θα οδηγήσει σε παραβλέψεις ζητημάτων ασφάλειας.

Στο AI 2027, η Κίνα βρίσκεται μόλις λίγους μήνες πίσω από τις ΗΠΑ καθώς πλησιάζει η ASI, γεγονός που πιέζει τις ΗΠΑ να συνεχίσουν με ταχείς ρυθμούς, παρά τις ενδείξεις για προβλήματα ευθυγράμμισης.

Σε γεωπολιτικό επίπεδο, η κούρσα για την ASI θα καταλήξει σε πόλεμο, συμφωνία ή έμμεση παράδοση.

Η ηγέτιδα χώρα θα αποκτήσει αποφασιστικό τεχνολογικό και στρατιωτικό πλεονέκτημα, ωθώντας τις υπόλοιπες να επιδιώξουν μια διεθνή συμφωνία («deal») για να το αποτρέψουν. Ελλείψει συμφωνίας, ίσως επιλέξουν τον πόλεμο αντί για μια «σιωπηρή παράδοση».

Κανένα έργο AI στις ΗΠΑ δεν είναι σε τροχιά ασφαλείας απέναντι σε επιθέσεις από κράτη μέχρι το 2027.

Στο AI 2027, η Κίνα υποκλέπτει το κορυφαίο αμερικανικό AI μοντέλο στις αρχές του 2027, γεγονός που επιδεινώνει τις ανταγωνιστικές πιέσεις μειώνοντας τον χρόνο προβάδισμα των ΗΠΑ. Δείτε τις προβλέψεις μας για την ασφάλεια για περισσότερες πληροφορίες.

Καθώς πλησιάζει η ASI, το κοινό πιθανότατα δεν θα γνωρίζει τις κορυφαίες δυνατότητες της τεχνητής νοημοσύνης.

Ήδη σήμερα, το κοινό υστερεί κατά μήνες σε σχέση με τις εσωτερικές δυνατότητες των AI. Μόλις τα AI αυτοματοποιήσουν την έρευνα για την ίδια την AI, αυτή η διαφορά μηνών θα μεταφραστεί σε τεράστιο χάσμα ικανοτήτων. Η αυξημένη μυστικότητα ενδέχεται να διευρύνει περαιτέρω αυτό το χάσμα. Αυτό θα οδηγήσει σε σχεδόν μηδενική εποπτεία πάνω σε καθοριστικές αποφάσεις, τις οποίες θα λαμβάνει μια μικρή ομάδα στελεχών AI εταιρειών και κυβερνητικών αξιωματούχων.